L’IA en 2026 : ce qui change vraiment et pourquoi

On parle beaucoup de modèles, de performances et de benchmarks. Sur le terrain, la réalité est ailleurs.

Ce que l’on voit surtout émerger, ce sont quatre bascules structurantes qui vont orienter, dès 2026, les décisions des DSI, CDO et dirigeants. Des bascules moins spectaculaires que les annonces produits, mais bien plus déterminantes pour la pérennité des organisations.

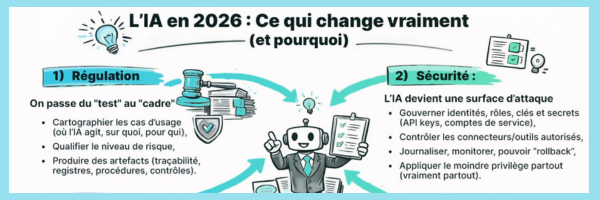

1. Régulation : du “test” au “cadre”

Avec l’AI Act en Europe, et des initiatives convergentes aux États-Unis, le message devient clair : l’IA n’est plus un gadget expérimental.

Elle influence des personnes, des décisions, des systèmes critiques. Elle doit donc être encadrée, documentée, traçable.

La logique change : on ne demande plus “est-ce que ça marche ?” On demande des preuves :

- transparence,

- gestion des risques,

- responsabilité démontrable.

Concrètement, cela implique de :

- cartographier les cas d’usage (où l’IA agit, sur quoi, pour qui),

- qualifier les niveaux de risque,

- produire des artefacts tangibles : registres, procédures, contrôles, traçabilité.

L’IA entre dans le champ de la conformité structurée.

2. Sécurité : l’IA devient une surface d’attaque

Le débat ne se limite plus à “l’IA peut se tromper”. Le vrai sujet est ailleurs. L’IA est désormais connectée :

- données,

- aux outils,

- aux actions (API, agents, automatisations, connecteurs).

Chaque connexion élargit la surface d’exposition. Et si les fondations IAM, permissions ou configurations cloud ne sont pas solides, le risque explose.

Concrètement, cela signifie :

- gouverner identités, rôles, clés et secrets (API keys, comptes de service),

- maîtriser les connecteurs et outils autorisés,

- journaliser, monitorer, être capable de revenir en arrière,

- appliquer réellement le principe du moindre privilège.

L’IA accélère tout. Y compris les failles.

3. Éthique : la confiance devient un actif (et un KPI)

La fatigue est palpable face à l’AI washing : promesses excessives → déceptions → perte de confiance. En parallèle, les cadres se structurent (UNESCO, instances internationales) autour de principes clairs :

- respect des droits humains,

- transparence,

- responsabilité,

- supervision humaine.

L’éthique cesse d’être un discours. Elle devient un levier de crédibilité. Concrètement, cela suppose de :

- expliquer ce que fait l’IA… et ce qu’elle ne fait pas,

- encadrer les usages sensibles (RH, finance, décision),

- protéger les personnes contre les biais, les atteintes à la vie privée ou la manipulation.

La confiance ne se décrète pas. Elle se construit.

4. Technique : de “répondre” à “simuler”

Une autre bascule est déjà à l’œuvre. L’IA ne se contente plus de produire des réponses. Elle commence à générer des environnements : simulation, interaction, scénarios.

Le jeu vidéo en est un laboratoire avancé. Mais cette logique va s’étendre à bien d’autres secteurs. Conséquences concrètes :

- chaînes de production accélérées,

- apparition de nouveaux rôles (pilotage, validation, contrôle qualité),

- enjeux renforcés sur la propriété intellectuelle, la traçabilité, l’impact sur l’emploi.

On ne parle plus seulement d’automatisation. On parle de reconfiguration des processus.

Notre conviction

L’IA ne remplace pas la gouvernance des données. Elle la rend indispensable. Sans cela, on obtient surtout :

- des réponses fausses,

- plus rapides,

- mieux présentées.

Mais toujours fausses.

Et vous ?

Dans votre organisation, la priorité pour 2026 est-elle plutôt :

- la conformité,

- la sécurité,

- la sobriété (FinOps / GreenOps),

- ou la transformation des métiers ?

Rédigé par Jawaher Allala